Seiring dengan lonjakan volume dan semakin canggihnya metode serangan jaringan, infrastruktur keamanan siber saat ini menghadapi tantangan yang semakin kompleks. Dalam upaya mitigasi, integrasi Deep Learning (DL) ke dalam Sistem Deteksi Intrusi (IDS) telah merevolusi kemampuan deteksi, khususnya dalam mengidentifikasi serangan zero-day dengan tingkat akurasi yang signifikan. Namun, keunggulan performa ini membawa konsekuensi serius berupa munculnya masalah ”black-box”. Sebagaimana ditekankan oleh Neupane et al. (2022) dan Capuano et al. (2022), model DL sering kali gagal memberikan penjelasan rasional mengenai mengapa suatu lalu lintas jaringan diklasifikasikan sebagai ancaman.

Ketidakmampuan ini menciptakan hambatan operasional dan psikologis bagi analis keamanan. Tanpa transparansi, keputusan otomatis sulit diverifikasi, yang berpotensi memicu ketidakpercayaan atau bahkan pengabaian terhadap peringatan keamanan yang kritis. Oleh karena itu, transparansi bukan lagi opsi tambahan, melainkan kebutuhan fundamental untuk memastikan efektivitas IDS dalam lingkungan produksi.

Untuk mengatasi ketidaktransparanan model, riset terkini berfokus pada adopsi teknik Explainable AI (XAI) bersifat post-hoc dan model-agnostic. Dua metode yang paling menonjol dalam literatur adalah SHAP (Shapley Additive Explanations) dan LIME (Local Interpretable Model-agnostic Explanations). Onyilo dan Uzuegbu (2025) serta Gaspar et al. (2024) menunjukkan bahwa metode ini sangat efektif ketika diintegrasikan dengan arsitektur kompleks seperti Multi-Layer Perceptron (MLP) atau hybrid CNN-LSTM.

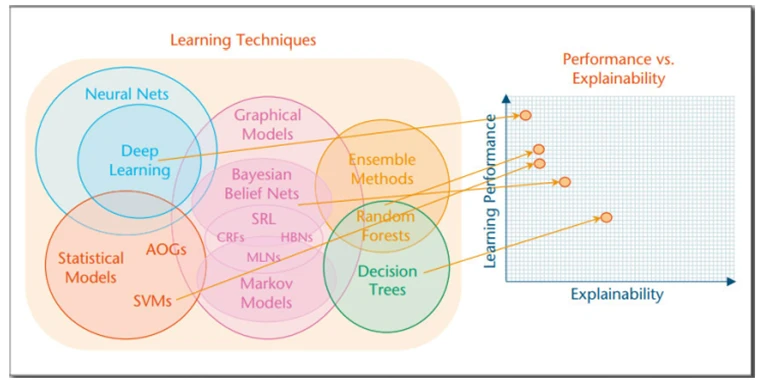

Peta Teknik Pembelajaran Mesin dan Hubungan Performance-Explainability Gaspar et.al (2024)

Melalui mekanisme kontribusi fitur, XAI memungkinkan identifikasi atribut spesifik seperti source bytes, flow duration, atau urutan system calls yang menjadi pemicu utama alarm keamanan. Temuan ini didukung oleh Udofot et al. (2024), yang membuktikan bahwa visualisasi penjelasan tersebut secara signifikan meningkatkan efisiensi kerja analis di Security Operations Center (SOC) dengan memberikan konteks yang jelas di balik setiap deteksi.

Integrasi XAI dalam IDS melampaui fungsi teknis semata; ini adalah langkah strategis menuju ekosistem AI yang etis dan bertanggung jawab. Terdapat tiga peluang utama yang diidentifikasi dari penerapan ini:

- Kerangka kerja Explainable IDS (X-IDS) selaras dengan standar global seperti EU AI Act dan panduan NIST. Standar ini menuntut akuntabilitas penuh pada sistem berbasis AI, terutama yang digunakan dalam infrastruktur kritis (Onyilo & Uzuegbu, 2025).

- Transparansi memungkinkan pengembang memahami akar penyebab kegagalan model, seperti false positives. Dengan informasi ini, penyempurnaan fitur dapat dilakukan secara lebih presisi untuk meningkatkan robustness model.

- XAI mengubah peran AI dari mesin otomatis menjadi mitra kolaboratif. Kemampuan AI untuk memberikan "argumen" atas keputusannya memfasilitasi kepercayaan pakar keamanan manusia terhadap sistem otomatis.

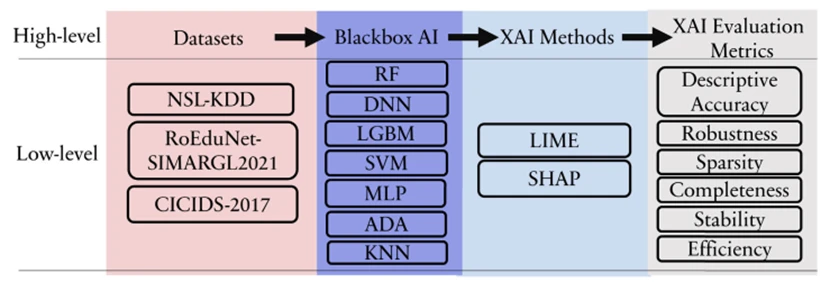

Arsitektur Framework Evaluasi XAI pada Model Machine Learning untuk Keamanan SiberArreche et al. (2024)

- Meskipun menjanjikan, hasil studi mengungkap beberapa tantangan fundamental yang belum sepenuhnya teratasi dan memerlukan perhatian serius:

Risiko Serangan Adversarial: Capuano et al. (2022) dan Arreche et al. (2024) memperingatkan bahwa XAI dapat menjadi "pedang bermata dua". Penyerang yang canggih dapat memanfaatkan penjelasan dari XAI untuk memetakan logika internal IDS, kemudian merancang serangan balik yang memanipulasi fitur agar tetap berada di bawah radar deteksi. - Beban Komputasi (Overhead): Proses generasi penjelasan menuntut sumber daya tambahan. Pada jaringan berkecepatan tinggi yang memproses jutaan paket per detik, menyediakan penjelasan secara real-time tanpa mengganggu performa deteksi merupakan hambatan teknis yang nyata.

- Standarisasi dan Stabilitas: Arreche et al. (2024), melalui kerangka kerja E-XAI, menyoroti ketidakstabilan penjelasan XAI. Gangguan kecil pada data input dapat menghasilkan penjelasan yang sangat berbeda, yang berpotensi membingungkan analis dan mengurangi keandalan sistem secara keseluruhan.

Evolusi menuju Explainable Intrusion Detection Systems (X-IDS) merupakan kebutuhan mendesak dalam ekosistem keamanan siber yang semakin otomatis. Penelitian saat ini telah membuktikan bahwa transparansi dapat dicapai tanpa mengorbankan akurasi, dengan kinerja mencapai >98% pada dataset benchmark. Namun, tantangan besar tetap ada pada aspek ketahanan terhadap manipulasi serangan dan standarisasi kualitas penjelasan.

Pengembangan masa depan harus berfokus pada penciptaan model yang transparan secara intrinsik (intrinsic interpretability) serta penguatan keamanan pada lapisan XAI itu sendiri. Hal ini bertujuan agar mekanisme penjelasan tidak menjadi celah baru bagi peretas, melainkan tetap menjadi pilar kepercayaan dalam pertahanan siber.

Referensi :

Arreche, O., Guntur, T. R., Roberts, J. W., & Abdallah, M. (2024). E-XAI: Evaluating black-box explainable AI frameworks for network intrusion detection. IEEE Access, 12, 23971-23988.

Capuano, N., Fenza, G., Loia, V., & Stanzione, C. (2022). Explainable artificial intelligence in cybersecurity: A survey. IEEE Access, 10, 93576-93600.

Gaspar, D., Silva, P., & Silva, C. (2024). Explainable AI for intrusion detection systems: LIME and SHAP applicability on multi-layer perceptron. IEEE Access, 12, 30161-30175.

Neupane, S., Ables, J., Anderson, W., Mittal, S., Rahimi, S., Banicescu, I., & Seale, M. (2022). Explainable intrusion detection systems (X-IDS): A survey of current methods, challenges, and opportunities. IEEE Access, 10, 112392-112415.

Onyilo, J., & Uzuegbu, V. C. (2025). Explainable artificial intelligence intrusion detection system: Improving transparency and trust in cybersecurity. Nature Journal of Emerging Sciences Technologies and Innovations, 1(1), 85-103.